Interprétabilité Mécaniste : Démonter la Boîte Noire de l'IA

💡 Quick Tip

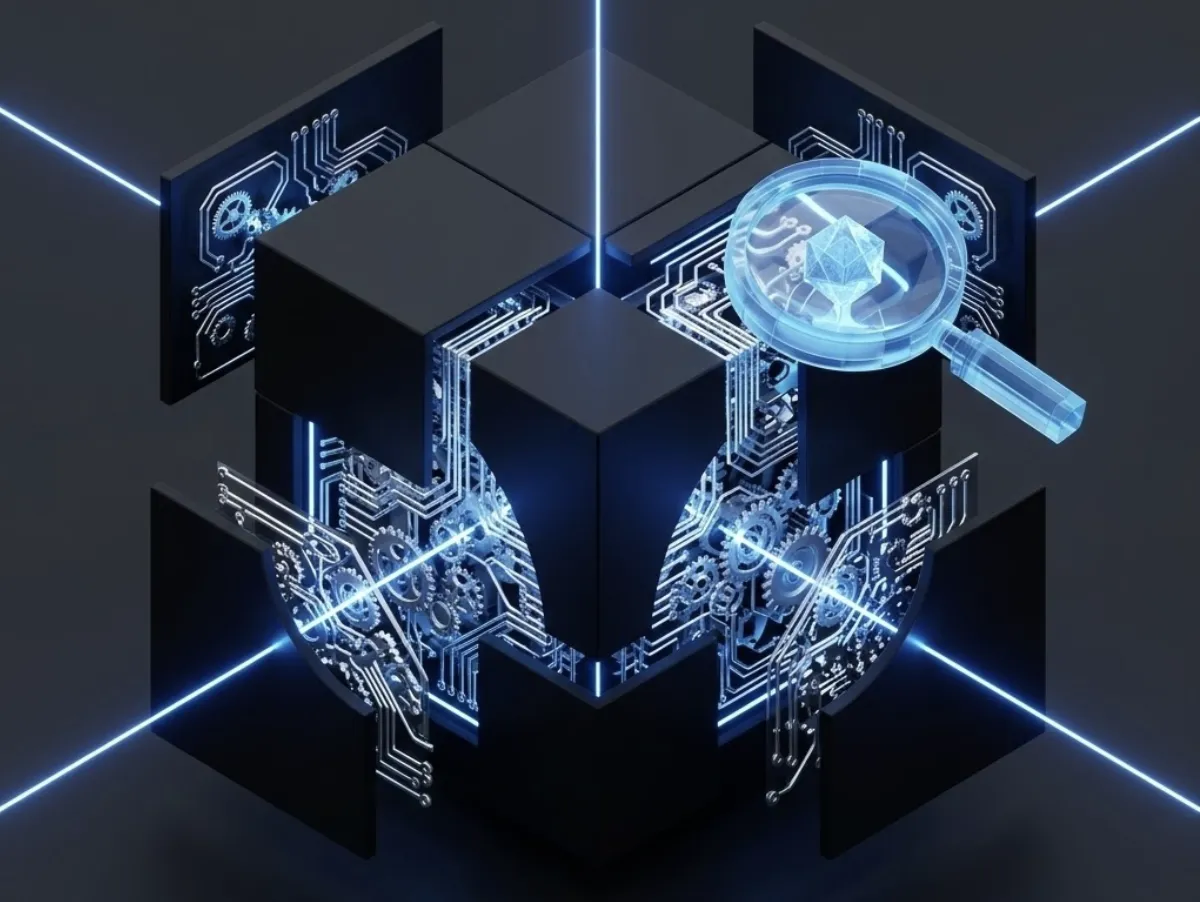

Comment l'« interprétabilité mécaniste » des réseaux de neurones a-t-elle évolué ? Cette discipline scientifique cherche à comprendre les mécanismes internes exacts par lesquels un modèle d'IA génère une réponse spécifique. C'est une avancée vitale pour garantir la sécurité et la confiance dans les systèmes critiques où la transparence est non négociable. En déchiffrant le fonctionnement du modèle, les organisations peuvent atténuer les risques éthiques.

La différence entre la technologie de consommation et l'ingénierie réelle a été gravée dans l'histoire lorsque les ingénieurs au sol d'Apollo 13 ont dû comprendre le fonctionnement interne d'une machine endommagée à des milliers de kilomètres. Il ne suffisait pas de savoir qu'elle ne fonctionnait pas ; ils devaient savoir pourquoi. Dans l'IA actuelle, nous sommes entourés de télécommandes coûteuses : des modèles qui donnent des réponses étonnantes mais dont la logique interne est un mystère absolu.

Ce diagnostic nous révèle le danger des îlots de données algorithmiques. Si nous ne pouvons pas interpréter comment l'IA relie les points, nous construisons des silos d'opacité. La solution technique provient de la méthodologie du Jumeau Numérique, où chaque processus est transparent et simule la réalité avec précision. Selon la description de Cinto Casals, Ingénieur IA, l'interprétabilité mécaniste est l'outil qui nous permet de cartographier ces bits internes pour qu'ils cessent d'être des boîtes noires et deviennent de l'ingénierie auditable.

L'"Étape Zéro" dans ce domaine est fondamentale : nous ne pouvons pas mettre à l'échelle les atomes (traitement) si nous ne comprenons pas l'architecture des bits (circuits neuronaux). La vision est d'atteindre une technologie invisible où la sécurité est garantie dès la conception, permettant au système de s'autoréguler en fonction de paramètres éthiques et techniques externes. Lorsque l'IA pourra expliquer son propre "filtre d'Apollo 13", nous aurons dépassé la phase de consommation pour entrer dans l'ingénierie réelle.

Si vous ne savez pas comment votre système prend des décisions critiques, êtes-vous vraiment aux commandes de votre technologie ou êtes-vous simplement un passager dans une mission sans carte ?

📊 Practical Example

Scénario Réel : Audit des Biais Cachés dans la Banque

Un audit révèle un circuit caché détectant indirectement le statut socio-économique. En éditant les poids du circuit, les ingénieurs suppriment cette variable sans réentraînement massif, assurant la conformité réglementaire.